Einführung in die Künstliche Intelligenz

Sommersemester 2026

| Vorlesung: | Donnerstag, | 09.30 - 11.00, A10.305 (1/305) | (Prof. F.H. Hamker) |

| Übung: | Montag, | 09.15 - 10.45, A13.219 (1/219) | (Dr. M. Teichmann, I. Koulouri) |

| Übung: | Donnerstag, | 13.45 - 15.15, A10.205 (1/205) | (Dr. M. Teichmann, I. Koulouri) |

Information

Anmeldung: https://bildungsportal.sachsen.de/opal/auth/RepositoryEntry/23116349499.

Inhalte

Einführung in das Gebiet der Künstlichen Intelligenz unter Bearbeitung folgender Themen:

- Intelligente Agenten

- Problemformulierung und Problemtypen

- Problemlösen durch Suchen

- Problemlösen durch Optimieren

- Optimierung und Constraints

- Probabilistische Methoden

- Neuronale Netze

- Informationstheorie

- Lernen von Entscheidungsbäumen

- Reinforcement Lernen

Randbedingungen

Empfohlene Voraussetzungen: Grundkenntnisse Mathematik I bis IV

Prüfung: 90-minütige Klausur, 5 Leistungspunkte

Literatur

- LeCun, Y., Bengio, Y. & Hinton, G.: Deep Learning. Nature, 521 (28 May 2015), p 436-444

- Bügeholz. H.: Mysteriöse Tiefe. Wie Google-KI den Menschen im Go schlagen will. c't 6/2016, p. 148-151

- Silver, D. et al.: Mastering the game of Go with deep neural networks and tree search. Nature 529 (28. January 2016) p. 484ff

- Browne, C. et al.: A Survey of Monte Carlo Tree Search Methods. IEEE transactions on computational intelligence and ai in games, 4(1):1-49 (March 2012)

- Heinert, M.: Support Vector Machines Teil 1: Ein theoretischer Überblick. zfv 3/2010 (2010)

Syllabus

- Was ist Künstliche Intelligenz (KI)?

- Ziele der KI

- Geschichte der Künstlichen Intelligenz

- Welche Disziplinen beeinflussen die KI?

- Wo stehen wir?

- Gefahren der KI

- KI an der TU Chemnitz

- Literatur

- What is Artificial Intelligence (AI)?

- Goals of AI

- The History of Artificial Intelligence

- Can we build intelligent machines?

- Which do disciplines affect the AI?

- AI an der TU Chemnitz

- Literature

- Problemformulierung

- Problemtypen

- Beispielprobleme

- Verbundwahrscheinlichkeit

- Summenregel

- Produktregel

- Bayes Theorem

- Apfel/Orange Beispiel

- A priori- und A posteriori Wahrscheinlichkeit

- Beispiele

- Bayesscher Wahrscheinlichkeitsbegriff

- Wahrscheinlichkeitsdichte

- Bayes Theorem für kontinuierliche Variablen

- Erwartungswert

- Varianz und Kovarianz

- Wahrscheinlichkeitsdichteverteilungen

- Optimierung - anschaulich

- Bergsteigen

- Simuliertes ausglühen

- Genetische Algorithmen

- Vergleich: Suche und Optimieren

- Lokale Suche in kontinuierlichen Räumen

- Gradientenverfahren

- Lagrangefunktion

- Einführung

- Aufbau künstlicher Neuronaler Netze

- Perzeptron und Trennbarkeit

- Historie und Zukunft Neuronaler Netze

- Lernen in künstlichen Neuronalen Netzen

- Lernen im Perzeptron

- Delta-Lernregel

- Backpropagation Lernregel

- Verwendung und Bewertung Neuronaler Netze

- Unüberwachtes und Hebbâsches Lernen

- Deep Learning

- Spiking Neuronen

- Reservoir Computing und Echo-State Netze

- Optimale Trennebenen

- SVM Entscheidungsregel

- Maximaler Rand

- Lagrange Optimierung

- Support Vektoren

- Soft Margin Klassifikator

- Nicht-lineare Grenzen

- Kernel

- Diskussion

- Elemente des Reinforcement Lernens

- Die Markov Eigenschaft

- Value Funktionen

- Bellmann Gleichungen

- Policy Evaluation

- TD Methoden

- SARSA

- Q-Learning

- Actor-Critic

- Eligibility traces

- Deep Q-Network

- Entropie

- Differentielle Entropie

- Verbundentropie

- Bedingte Entropie

- Kullback-Leibler-Distanz

- Gemeinsame Information

- Klassifikation

- Aufbau eines Entscheidungsbaums

- Klassifikation neuer Beispiele

- Lernen von Entscheidungsbäumen

- Informationsgewinn

- ID3

- Informationsgewinnverhältnis

- C4.5

- Grundlagen

- Qualität von Schätzern

- Kleinste-Quadrate-Schätzer

- Maximum Likelihood

- Cue Integration

- Bayesian Schätzer

- Maximum a posteriori (MAP) Schätzer

- EM Algorithmus

-

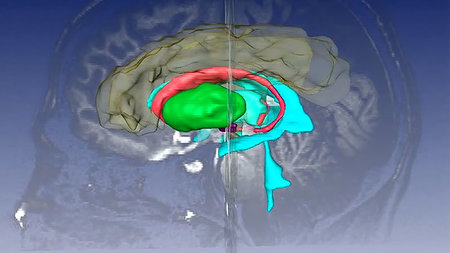

Welche Schaltkreise im Gehirn bestimmen unser Alltagsverhalten?

Vom dualen System zum Netzwerk: Forschungsteam aus Chemnitz, Santiago de Chile und Magdeburg hat eine neue Sicht auf die Handlungssteuerung im Gehirn und ihren Nutzen für die Entwicklung neuroinspirierter KI …

-

Gehirn-Schluckauf besser verstehen

Projektstart für deutsch-israelisch-amerikanisches Kooperationsprojekt zur Erforschung von Tourette- Ursachen …

-

Mit SmartStart 2 auf dem Weg zur Promotion

Oliver Maith, der in Chemnitz Sensorik und kognitive Psychologie studierte, war in einem wettbewerblichen Verfahren zur Promotionsförderung erfolgreich und forscht nun im Bereich der Computational Neuroscience …

-

Innovative KI-Anwendungen stehen im Mittelpunkt der ISCSET 2026

Professur Technische Informatik der TU Chemnitz gehört zum Organisationsteam des 15. Internationalen Symposiums für Informatik und Bildungstechnologie (ISCSET), das im August 2026 in Sachsen stattfindet …

-

Philosophische Fakultät JustArts Just Representation

Das internationales Symposium rückt verschiedene Formen der Repräsentation von Geflüchteten in den …

-

Mathematik Zur Bedeutung von Zahlen im Judentum

Im Vortrag geht es um die Bedeutung von Zahlen im Judentum und um ihre statistische Verteilung in …

-

TU Chemnitz TUCsportfest2026

Spaßwettkämpfe in der neuen Sporthalle und auf den Außensport- und Grünanlagen des Campus …

-

Naturwissenschaften 55. Chemiewettbewerb "Julius Adolph Stöckhardt" an der TU Chemnitz

Das Thema des Chemiewettbewerbes lautet: "Aluminium, Kupfer und Wolfram …

-

TU Chemnitz Graduiertenfeier

Die TU Chemnitz möchte allen Absolvent*innen zum erfolgreichen Abschluss gratulieren und in …

-

TU Chemnitz TUCsommernacht

Tanz und gute Laune bis Mitternacht: Verschiedene Musik- und kulinarische Angebote sorgen im …